Manaus, 22 de abril de 2026 – O uso de inteligência artificial, deepfakes e outras formas de manipulação digital transformou as eleições gerais de outubro de 2026 em um dos processos mais desafiadores da história recente do país. Em resposta, o Tribunal Superior Eleitoral (TSE) aprovou, em março, a Resolução nº 23.755, que estabelece regras inéditas para propaganda eleitoral, com foco na transparência e no controle de conteúdos sintéticos. A norma tenta adaptar a justiça eleitoral brasileira a uma onda global de desinformação que marcou o ciclo eleitoral desde 2024, considerado o maior da história, com impacto em cerca de 3,65 bilhões de eleitores.

Episódios recentes evidenciaram o potencial disruptivo dessas tecnologias. Na Eslováquia, um áudio falso circulou às vésperas da eleição sugerindo fraude eleitoral, enquanto nos Estados Unidos um robocall com voz clonada do então presidente Joe Biden incentivou eleitores a não participarem das primárias, resultando em multa de mais de U$ 6 milhões. Esses casos consolidaram o entendimento de que a desinformação digital não é mais um risco hipotético, mas uma variável concreta do jogo político.

O avanço regulatório e o cerco às deepfakes

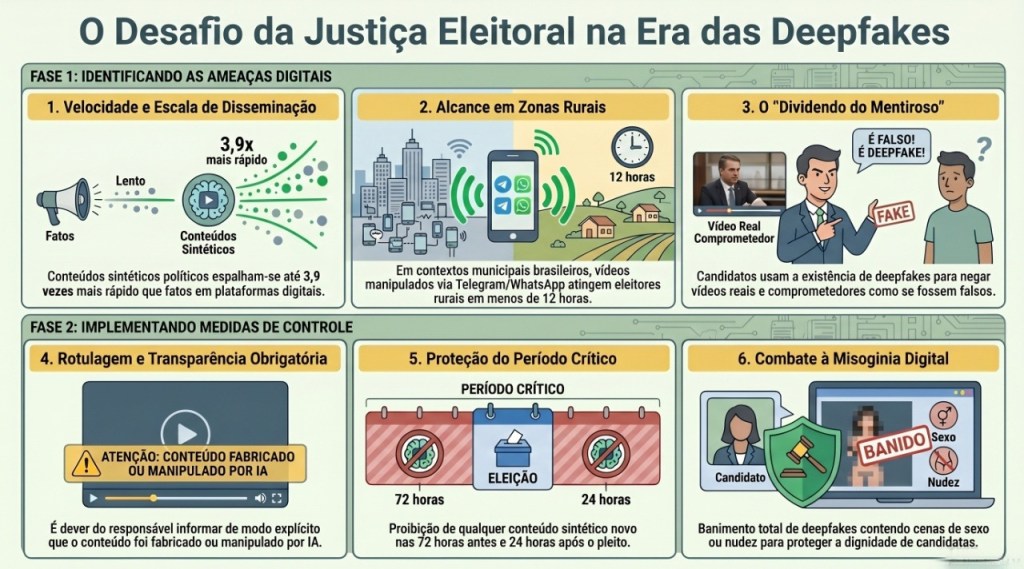

A Resolução nº 23.755 introduz o conceito de conteúdo sintético multimídia, as chamadas deepfakes, obrigando campanhas a identificarem de forma explícita qualquer material gerado ou manipulado por inteligência artificial, inclusive indicando a tecnologia utilizada. A norma também proíbe a circulação de novos conteúdos sintéticos — mesmo que devidamente rotulados — nas 72 horas que antecedem o pleito e nas 24 horas seguintes, criando uma zona de proteção em torno dos chamados momentos decisórios do eleitor.

“A exigência de rotulagem é um avanço importante, mas sozinha não resolve o problema”, afirma a especialista em inteligência artificial Vitória Luz, especialista em Inteligência Artificial aplicada aos negócios, certificada pela Kellogg School of Management. Ela explica que a medida cria um padrão mínimo de transparência e permite algum nível de rastreabilidade, mas depende de mecanismos eficientes de fiscalização e resposta rápida.

“Rotular depende de cumprimento voluntário ou de detecção posterior, e o dano pode ocorrer em poucas horas, muito antes de qualquer intervenção”, diz. Segundo Vitória, a regulação alcança com mais precisão a propaganda formal, mas tem dificuldade em atingir redes informais, grupos fechados e fluxos orgânicos de distribuição.

Além disso, a resolução amplia o alcance jurídico ao estabelecer responsabilidade solidária para plataformas digitais, que passam a responder conjuntamente com os autores em caso de descumprimento de decisões judiciais. A norma também proíbe que sistemas de IA sejam utilizados para ranquear ou recomendar candidaturas, buscando limitar a interferência algorítmica invisível no comportamento do eleitor.

A ameaça além da tecnologia: percepção, comportamento e manipulação

Estudos experimentais recentes indicam que o impacto da desinformação eleitoral não está restrito às tecnologias mais sofisticadas. Pesquisa publicada em 2025 no periódico The International Journal of Press/Politics, intitulada “Deepfakes as a Democratic Threat: Experimental Evidence Shows Noxious Effects That Are Reducible Through Journalistic Fact Checks”, demonstra que eleitores tendem a confiar em conteúdos audiovisuais independentemente de serem deepfakes — gerados por inteligência artificial — ou cheapfakes, produzidos a partir de manipulações simples, como cortes, desaceleração ou descontextualização de falas.

O estudo reforça o efeito da chamada primazia visual, que é a tendência das pessoas de acreditarem mais no que veem ou ouvem do que no que leem. Na prática, isso significa que, para o eleitor, não faz tanta diferença se o vídeo foi criado com tecnologia avançada ou apenas editado de forma simples. Mesmo conteúdos manipulados de maneira básica podem parecer convincentes e causar o mesmo tipo de impacto que materiais mais sofisticados.

“Não é preciso criar um vídeo hiper-realista para afetar a eleição”, explica a especialista em inteligência artificial Vitória Luz. Segundo ela, conteúdos plausíveis — mesmo com manipulações simples — são capazes de influenciar narrativas quando distribuídos em escala. A pesquisa também aponta que intervenções jornalísticas podem reduzir significativamente esses efeitos.

“O efeito assimétrico de tempo continua sendo um desafio, porque desmentir sempre demora mais do que viralizar”, afirma a especialista. Ainda assim, o estudo identificou que checagens de fatos em formato audiovisual conseguem mitigar danos reputacionais quase ao nível de normalidade, desde que realizadas com rapidez e robustez, destacando o papel do jornalismo profissional em contextos de alta circulação de desinformação.

Velocidade, escala e os limites da resposta institucional

A resolução do TSE foi desenhada para proteger momentos críticos do processo eleitoral, especialmente os dias finais da campanha. No entanto, evidências recentes da literatura científica indicam que o principal risco não está necessariamente em eventos isolados, mas na erosão gradual do ambiente informacional ao longo do tempo.

Trabalhos como a revisão publicada em 2026 sobre desinformação gerada por IA e o estudo de 2025 no periódico The International Journal of Press/Politics — “Deepfakes as a Democratic Threat: Experimental Evidence Shows Noxious Effects That Are Reducible Through Journalistic Fact Checks” — apontam que o impacto mais relevante ocorre de forma contínua, com acúmulo de conteúdos ao longo da campanha.

“O maior perigo não é um vídeo bombástico, mas a poluição contínua do debate público”, afirma Vitória Luz. Ela explica que campanhas de desinformação de baixa intensidade, distribuídas ao longo de meses, podem gerar desengajamento e apatia no eleitorado.

A velocidade de propagação desses conteúdos também representa um desafio significativo. Estudo publicado em 2025 na revista científica Science Advances, intitulado “The spread of true and false news online: 2025 revisit”, indica que materiais falsos — incluindo conteúdos sintéticos — podem se espalhar até 3,7 vezes mais rápido do que informações factuais, criando uma vantagem estrutural para a desinformação.

A especialista destaca as dificuldades enfrentadas pelas plataformas digitais. “Detectar conteúdo manipulado com alta precisão continua sendo difícil, especialmente em áudio e materiais curtos”, afirma. Segundo ela, o volume de dados gerados durante campanhas eleitorais amplia a complexidade da moderação.

Além disso, há desafios relacionados ao contexto dos conteúdos. “Muitas vezes o problema não está apenas no vídeo ou áudio, mas na legenda, na atribuição ou no momento da publicação”, explica. Isso torna a análise mais complexa e exige respostas que vão além da simples remoção de arquivos.

Zonas cinzentas e novas estratégias de influência

Outro ponto de atenção identificado pela análise é o uso da inteligência artificial para fins considerados legítimos, como o embelezamento de candidatos ou a adaptação de discursos para diferentes públicos. Casos internacionais mostram líderes políticos utilizando IA para falar idiomas que não dominam, como o primeiro-ministro Narendra Modi, na Índia, e o presidente Joko Widodo, na Indonésia, criando uma conexão artificial com eleitores de diferentes regiões e grupos linguísticos.

Vitória Luz aponta que sistemas de geração de textos, imagens e comentários em escala também representam uma ameaça relevante. “Hoje me preocupam os robôs conversacionais que fingem ser pessoas reais, a microssegmentação opaca e os sistemas de recomendação que amplificam conteúdos polarizadores”, diz. Segundo ela, esses mecanismos atuam de forma menos visível, mas potencialmente mais eficaz.

Outro desafio é a integração entre diferentes sistemas de comunicação. “IA eleitoral não é só um problema de redes sociais, mas também de telecomunicações e infraestrutura digital”, afirma. Ela cita a necessidade de coordenação entre instituições para responder a esse cenário complexo.

Entre a regulação e a realidade informacional

Apesar dos pontos vulneráveis, a Resolução nº 23.755 posiciona o Brasil entre os países com legislação mais avançada sobre o uso de inteligência artificial em eleições. A norma responde diretamente a riscos identificados em experiências internacionais e incorpora mecanismos jurídicos como a inversão do ônus da prova, que transfere ao acusado a responsabilidade de comprovar a veracidade de conteúdos quando a perícia técnica for complexa.

A questão, a partir daí, deixa de ser burocrática e passa a ser técnica. Mais precisamente na capacidade da Justiça Eleitoral brasileira agir com rapidez e precisão. “Não basta ter norma. É preciso ter capacidade operacional para a janela crítica antes da votação”, afirma Vitória Luz. Ela destaca que a efetividade da regulação depende da velocidade de resposta e da coordenação entre instituições.

A especialista também ressalta o papel da sociedade nesse cenário. “A defesa mais eficaz não será apenas tecnológica, mas baseada em educação midiática e verificação contínua”, diz. Segundo ela, jornalistas e eleitores precisam adotar práticas mais rigorosas de checagem diante do novo ambiente informacional.

Descubra mais sobre Vocativo

Assine para receber nossas notícias mais recentes por e-mail.